19 февраля на Зимней сессии ежегодной конференции «Оценка персонала 2026» журнала «Штат» выступил Рубен Арутюнян, IT-директор компании «Бизнес Психологи» (ex SHL Russia). Он представил предварительные результаты практико-ориентированного исследования технологий ИИ в процедурах оценки персонала, но начал с ироничных наблюдений за бушующим уже несколько лет ИИ-хайпом.

Первый парадокс, по мнению эксперта, состоит в том, что сектор ИИ получает значительные объемы финансирования, считается драйвером экономики, но при этом с завидной регулярностью генерирует некорректные результаты. Такого количества ошибок не прощали, кажется, ещё ни одной технологии.

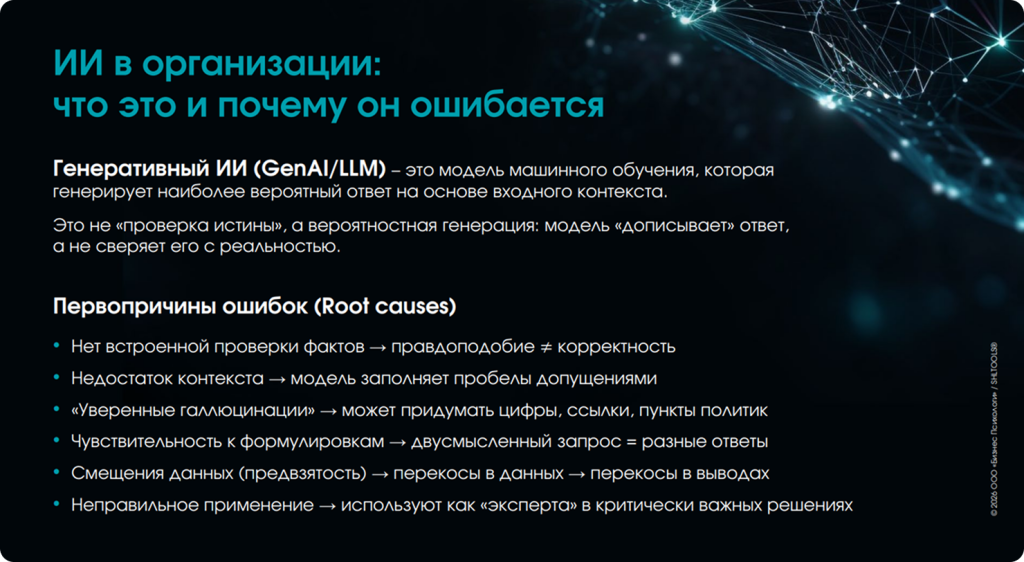

Второй парадокс в том, уверен Рубен Арутюнян, что очень немногие люди знают, как именно работают нейросети. Большинство современных нейросетевых архитектур функционируют на принципе последовательной генерации слов. При отсутствии релевантной информации LLM-модель выдает ерунду очень уверенно, потому что её создателям не нужно, чтобы она честно сообщала пользователю, что ответа на вопрос не знает. Поэтому проблема галлюцинаций и фабрикации данных нейросетью в ближайшее время не может быть решена, считает Рубен Арутюнян.

«Фабрикация информации является имманентной характеристикой архитектуры моделей, а не техническим дефектом».

Вероятностный характер ответов нейросети приводит к ещё одному парадоксу: на один и тот же вопрос одна и та же нейросеть может отвечать по-разному. Этот факт, комментирует IT-директор компании «Бизнес Психологи», ярко свидетельствует о том, что полагаться на ответы нейросети в сколько-нибудь значимых вопросах, не стоит.

«Каждый раз, когда вам говорят, что нейронка думает, вспоминайте мои слова: она просто берет вопрос, превращает его в контекст и генерирует следующее наиболее вероятное слово из тех данных, на которых её обучили».

Ещё один парадокс, который имеет непосредственное отношение к использованию ИИ в оценке персонала: автоматизированные системы действительно могут быть более честны и объективны, чем люди, когда отбирают кандидатов из демографической группы с лучшими результатами. Распределение будет реальным, т.к. человеческих предубеждений у системы нет.

Есть еще один парадокс, который может возникать при использовании подобных систем. Их результаты могут быть посчитаны необъективными и предвзятыми на основании того, что они не соответствуют видению использующего их, хоть как раз система может быть абсолютно непредвзята.

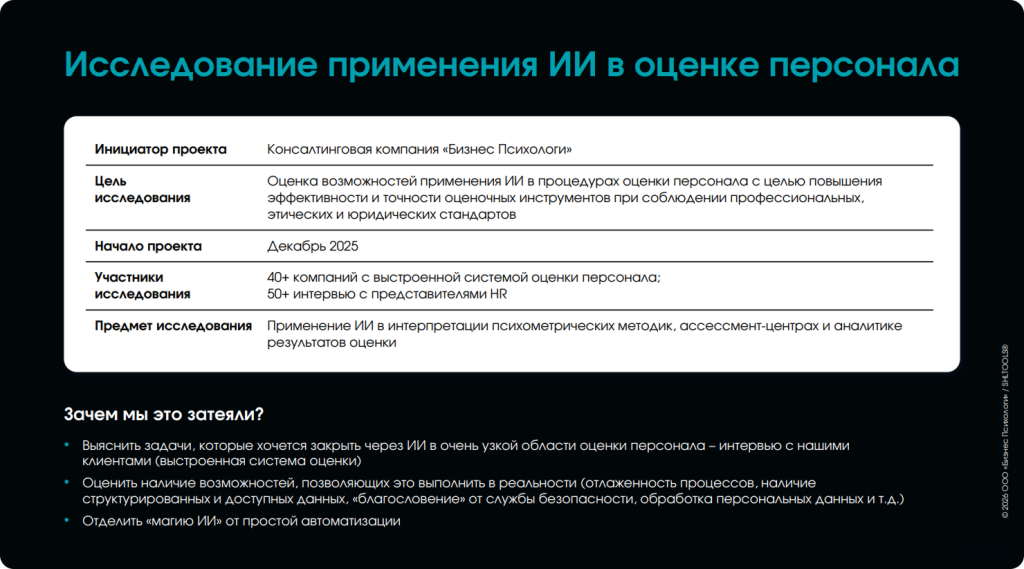

Компания «Бизнес Психологи» продолжает исследование применения ИИ в оценке персонала, чтобы узнать, как компании используют нейросетевые инструменты в этой сфере, какие задачи они в принципе готовы доверить ИИ, насколько они знакомы с возможностями автоматизации процессов оценки, чего ждут от ИИ в оценке персонала в ближайшем будущем и так далее.

На основе анализа бесед с представителями более чем 40 компаниями с выстроенной системой оценки персонала удалось сформулировать следующие наблюдения и выводы:

Проведенное исследование подтвердило существование значительных барьеров внедрения нейросетевых решений в области оценки персонала. Сейчас основная роль нейросетей — это автоматизация рутинных, стандартизируемых задач и поддержка HR-специалистов. Внедрение технологий ИИ требует высокой экспертной подготовки. Для внедрения в HR-процессы (не только в оценку) необходима стандартизация подходов к использованию нейросетевых инструментов. Автоматизированные решения сохраняют прозрачность и воспроизводимость результатов. Компания «Бизнес Психологи» планирует продолжать мониторинг ситуации с ИИ в оценке персонала.

Оставьте свои контактные данные и наш специалист свяжется с вами в ближайшее время.